Qui ?

Vincent Luciani, Pdg et Hanan Ouazan(en photo) lead generative AI Artefact.

Quoi ?

L'introduction de la matinée "L'IA générative: révolution et opportunités pour les entreprises" , "organisée jeudi dernier dans les locaux de l'une des principales agences en data, qui s'est rebaptisée "AI Technology solutions".

Comment ?

Jeudi dernier, Artefact faisait salle comble avec un beau parterre d'entreprises qui en deux heures ont eu un tour d'horizon de l'IA, sa régulation et ses premières applications dans l'entreprise. Il est bien loin le temps où Artefact se penchait sur des chabots où il fallait imaginerons les scenarios : "Ce qui sortait était ce qui entrait" se souvient Vincent Luciani. Après la transformation digitale, la transformation data, les entreprises vont devoir se transformer pour intégrer l'IA.

Un rythme d'annonces épuisant

La révolution comporte évidemment des risques : Samsung s'est mordu les doigts d'avoir partagé de l'information confidentielle avec Chat GPT. Et des enjeux juridiques : Getty Image a entamé un procès contre Stability IA. Sans compter la désinformation dopée à l'IA. Sans compter la pollution et el cout carbone de ces nouvelles technologies. Dans ce nouveau domaine, les GAFAM trouvent naturellement leur place, grâce à la puissance de calcul qu'elles ont développée. "Ces dernières semaines ont été épuisantes à suivre, avec un rythme d'annonces effréné" reconnait Vincent Luciani, qui a pris sur ses heures de sommeil pour proposer au public de cette matinée une information et des intervenants up to date. Cette rapidité pose un gros problème aux régulateurs. "La rapidité de l'innovation en LLM font que les textes de loi adoptés par l'Europe sont devenus caducs depuis ChatGPT. L'Europe veut sur réglementer, ce qui anéantit sa capacité de riposte aux initiatives américaines et asiatiques" explique Igor Carron, le Pdg de Light On (voir notre autre papier).

Un rythme d'adoption galopant, mais qui se calme

ChatGPT a eu 1 M utilisateurs en 5 jours, un seuil atteint par Tik Tok en 14 jours, Instagram en 2,5 mois et Facebook en 10 mois. En trois mois le coût d'hébergement a été divisé par dix.

La fuite sur les réseaux sociaux des paramètres de Llama (le modèle IA de Meta), était-elle volontaire ? En tout cas, elle a généré en deux mois tout un écosystème, avec Vicuna, Dolly Colossal Chat ou Nebuly. En termes de performance, "Nous arrivons à un plateau. Sam Altmann, qui dirige Open AI, a déclaré qu'il ne développait pas de ChatGPT5." explique Hanan Ouazan.

Autre aspect de l'accélération : chaque deux ou trois ans des équipes plus petites génèrent deux à trois fois plus de revenu, explique Igor Carron de Light On. Cette société française de LLM compte 20 personnes. Pour construire un LLM, i faut 7 à 8 personnes. Quand on se compare aux GAFAM, notre équipe est minuscule. Mais en étant dix fois moins nombreux, on a un même niveau de technicité. Ces petites équipes ont un effet démesuré"- NDLR : avoir en tête quand Google fusionne cette semaine ses deux équipes IA, voir notre revue de web.

Nos lecteurs ont appris les 3 modalités d'intégration d'un Large Language Model (LLM, voir cet article)

Petit rappel : quand on veut s’accaparer modèle LLM comme Llama ou Chatgpt on peut :

- Le brancher directement aux données : le modèle n'est pas touché et se nourrit aux données externes.

- L'affiner (ca coûte des dizaines de milliers d'euros)

- Créer un modèle spécifique (pour des domaines comme la santé et la finance, par exemple). Ce qui demande un investissement de l'ordre de millions d'euros.

Souvent affiner un modèle revient moins cher in fine : "Quand on adapte un modèle, il faut moins besoin d'explications. La taille du prompt et le coût associé à la requête diminue" explique Hanan Ouazan chez Artefact.

Brancher son FAQ sur ChatGPT

Une grande banque a testé le prompt ingeneering pour introduire de l'intelligence artificielle dans ses FAQ, avec un bon résultat. Les réponses sont très claires, avec leur source.

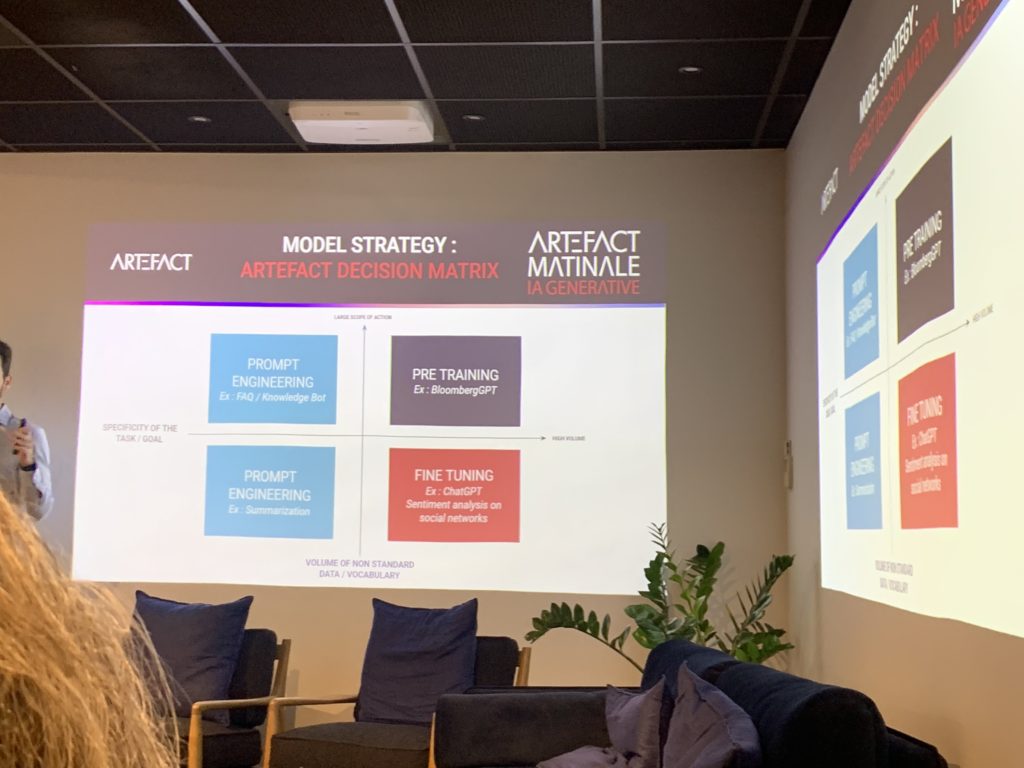

Ce tableau permet de déterminer l'approche, en prenant comme critères le volume de données et de vocabulaire spécifique et la spécificité des tâches. Ainsi, si l'on veut analyser les sentiments sur les réseaux sociaux, il faut faire du fine tuning, et si l'on traite beaucoup de texte spécifique, il faut pré-entrainer le modèle, comme Bloomberg l'a fait en créant son propre modèle de LLM spécialisé dans la finance. Mais si l'on n'a pas beaucoup de données spécifique, ni de tâches spécifiques, (résumer des textes ou traiter en mode automatique les questions fréquentes, par exemple), le prompt engineering suffit. Si le nombre des données augmente, il faut aller vers du finetuning : Chat GPT est le modèle fine tué de GPT pour le chat.

Ce tableau permet de déterminer l'approche, en prenant comme critères le volume de données et de vocabulaire spécifique et la spécificité des tâches. Ainsi, si l'on veut analyser les sentiments sur les réseaux sociaux, il faut faire du fine tuning, et si l'on traite beaucoup de texte spécifique, il faut pré-entrainer le modèle, comme Bloomberg l'a fait en créant son propre modèle de LLM spécialisé dans la finance. Mais si l'on n'a pas beaucoup de données spécifique, ni de tâches spécifiques, (résumer des textes ou traiter en mode automatique les questions fréquentes, par exemple), le prompt engineering suffit. Si le nombre des données augmente, il faut aller vers du finetuning : Chat GPT est le modèle fine tué de GPT pour le chat.

La fin du travail ?

L'IA va avoir un impact important : 80 % des employés peuvent etre remplacés sur 10 % des tâches. Et notamment chez les cols bancs. Les mathématiciens, les tracer, les avocats vont devoir fortement évoluer.

"Ce qui vient, c'est la façon d'intégrer ces modèles aux business" explique Hanan Ouazan. Lancée le 30 mars dernier sur GitHub, Auto-GPT est une application Python expérimentale et open source qui utilise GPT-4 pour agir de manière autonome. Cela signifie qu’Auto-GPT peut effectuer une tâche avec peu d’intervention humaine. Par exemple, vous pouvez dire à Auto-GPT quel est votre objectif final et l’application produira elle-même les prompts nécessaires à l’accomplissement de la tâche. L’application est pilotée par GPT4. Chez Microsoft, Jarvis suit le même mouvement.

Les pistes pour les entreprises

-La fin des call center ?

Actuellement, l'IA générative génère de nombreuses réflexions sur les call center ou les centres d'appels pour les auditeurs par exemple. "En 48 h, un bot connecté à des bases de données peut proposer des réponses pertinentes en mode POC".

- La génération de contenus : création d'images (voir Photoroom, dans notre autre papier) de son, de texte, documentation, traduction.Et l'avénement, sous une autre forme, des fermes de contenu des années 2010.

Il y a quelques semaines, j’ai voulu tenter une expérience.

Et si on laissait réellement à des IA les rênes d’un site ? J’ai donc créé un network de sites gérés à 100% par des IA (#chatGPT notamment), totalement autonomes… Le network Generation !

Thread explicatif ⤵️⤵️ pic.twitter.com/2GlaVeqYvA— Ari Kouts (@arikouts) April 20, 2023

- De nouvelles interfaces

GPTX, l'extension de Chrome peut créer la révolution dans l'environnement numérique. "Kayak, Booking ou Opentable pourront voir leur business model remis en question".

- Le juridique : Photoroom a créé en une heure l'assignation pour un concurrent, avec Chat GPT.

- La délégation de tâches : un agent autonome réserve les billets ou organise les séminaires, par exemple.

- "La publicité, de cookie based, va devenir content based, avec des publicités plus intéressantes" prédit Vincent Luciani.